心智观察所:哈梅内伊不是AI杀死的(4)

但这距离“AI杀死哈梅内伊”的说法有着天壤之别。Claude的功能是处理和分析非结构化数据——比如翻译和归纳截获的波斯语通信、在海量情报中识别模式、为指挥官提供多种场景下的态势分析。Semafor在2月17日的独家报道中引述了一个关键细节:Anthropic在Palantir的一次例行沟通中,对Claude在委内瑞拉马杜罗行动中的使用表达了关切。Palantir高管将这次对话汇报给了五角大楼,最终引发了五角大楼与Anthropic之间的公开决裂。

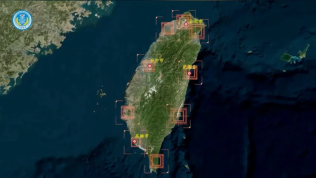

在这场军事行动中,大量AI制作的假新闻、假图片在网上流传

更值得注意的是Semafor报道中的一句话:Claude在掳走马杜罗行动中“没有发挥任何有意义的作用——不是因为伦理原因,而是因为这项技术还不够好”。CBS新闻的报道也引用了一位知情人士的说法:Claude“并非不会产生幻觉,也不够可靠,无法避免潜在的致命错误,如意外升级或没有人类判断下的任务失败”。这恰恰是Anthropic坚持保留安全护栏的核心理由——不是出于政治立场,而是出于对技术局限性的清醒认知。

将这些信息综合起来,一个远比科幻叙事更平实的图景浮现出来:

Claude在军事情报流程中扮演了一个有用但有限的辅助角色,类似于一个能力极强的翻译和分析助手。它没有“追踪”哈梅内伊,没有“锁定”任何目标,更没有“扣动扳机”。

真正追踪哈梅内伊的,是CIA的人力情报网络;真正锁定目标的,是卫星和信号情报系统;真正执行打击的,是以色列空军飞行员驾驶的F-35I战斗机和美军发射的巡航导弹。

帕兰提尔:真实的嵌入与被夸大的角色

夸大AI军事作用的文章对帕兰提尔的描述并非全无根据,但将其功能无限放大为“战场大脑”则显然过度渲染。

帕兰提尔在美国军事体系中确实占据了越来越核心的位置——这一点毋庸置疑。2024年,五角大楼授予帕兰提尔价值4.8亿美元的Maven Smart System合同;2025年5月,合同上限提升至近13亿美元;同年8月,美国陆军授予帕兰提尔一份长达十年、上限100亿美元的企业协议,将75个分散合同整合为一。帕兰提尔的Maven系统到2025年初已拥有超过2万名活跃用户,覆盖35个军事工具。